O desenvolvedor que construiu o modelo foi embora.

A consultoria que fez o deploy encerrou o contrato.

O gerente que aprovou o projeto foi promovido e não levou o modelo com ele.

O modelo continua rodando.

Continua tomando decisões.

Ninguém sabe ao certo o que ele faz, com quais dados, com qual critério.

Isso tem nome: IA Orphan. E toda empresa com mais de dois anos usando IA tem pelo menos um.

O que é IA Orphan

IA Orphan é qualquer modelo em produção que não tem:

- Responsável técnico identificado e acessível

- Documentação de comportamento esperado

- Processo ativo de monitoramento

- Critério definido para retreinamento ou desativação

Não precisa ser um modelo antigo. Um modelo de seis meses pode ser órfão se o time que o construiu saiu e ninguém assumiu formalmente.

A palavra-chave é "formalmente". Informalmente todo mundo sabe que o modelo existe. Formalmente ninguém responde por ele.

Como acontece — as 4 origens mais comuns

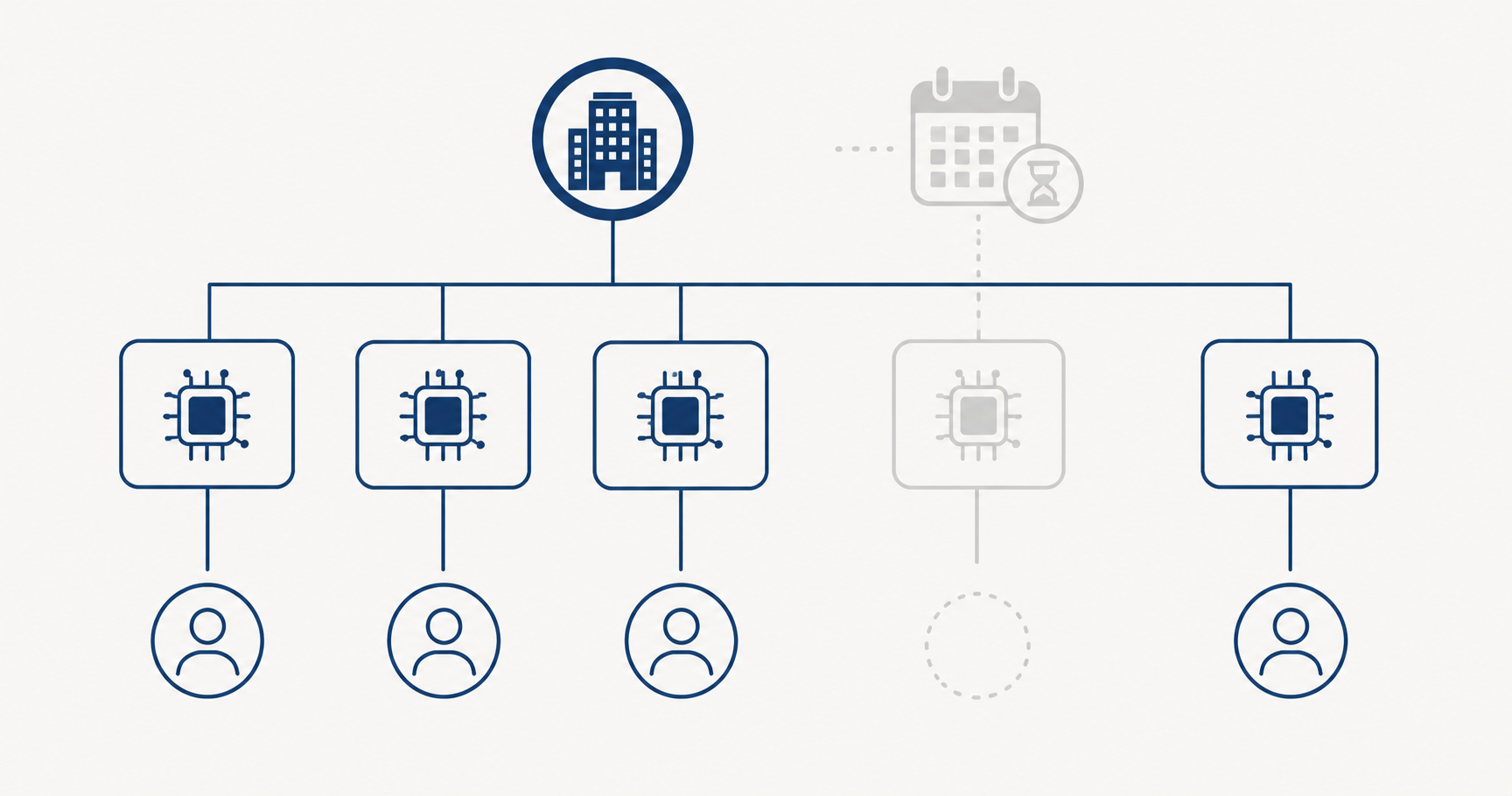

Turnover na área de dados. O cientista de dados que treinou e conhece o modelo sai da empresa. Ninguém onboarding formal. O conhecimento vai embora junto. O modelo fica.

Fim de contrato de consultoria. A consultoria entregou o modelo, o relatório e a apresentação. O contrato encerrou. Não havia cláusula de transferência de responsabilidade operacional. O cliente ficou com o artefato, sem o contexto.

Reorganização interna. O modelo pertencia à área de inovação. A área foi fundida com tecnologia. Na reestruturação, o modelo caiu no limbo — nenhuma das duas áreas assumiu ownership explícito.

Proliferação de modelos sem catalogação. A empresa tem 40 modelos em produção mas rastreamento para 28. Os outros 12 existem em servidores, pipelines ou APIs internas que ninguém documenta sistematicamente. Ninguém os desativou. Ninguém os monitora.

Os quatro cenários têm o mesmo resultado: modelo em produção, sem dono, tomando decisões que afetam clientes ou operações.

Sua empresa tem esse controle hoje?

Faça o checklist em 5 minutos — gratuito.

Baixar checklist gratuitoO ciclo de vida de IA e onde o risco mora

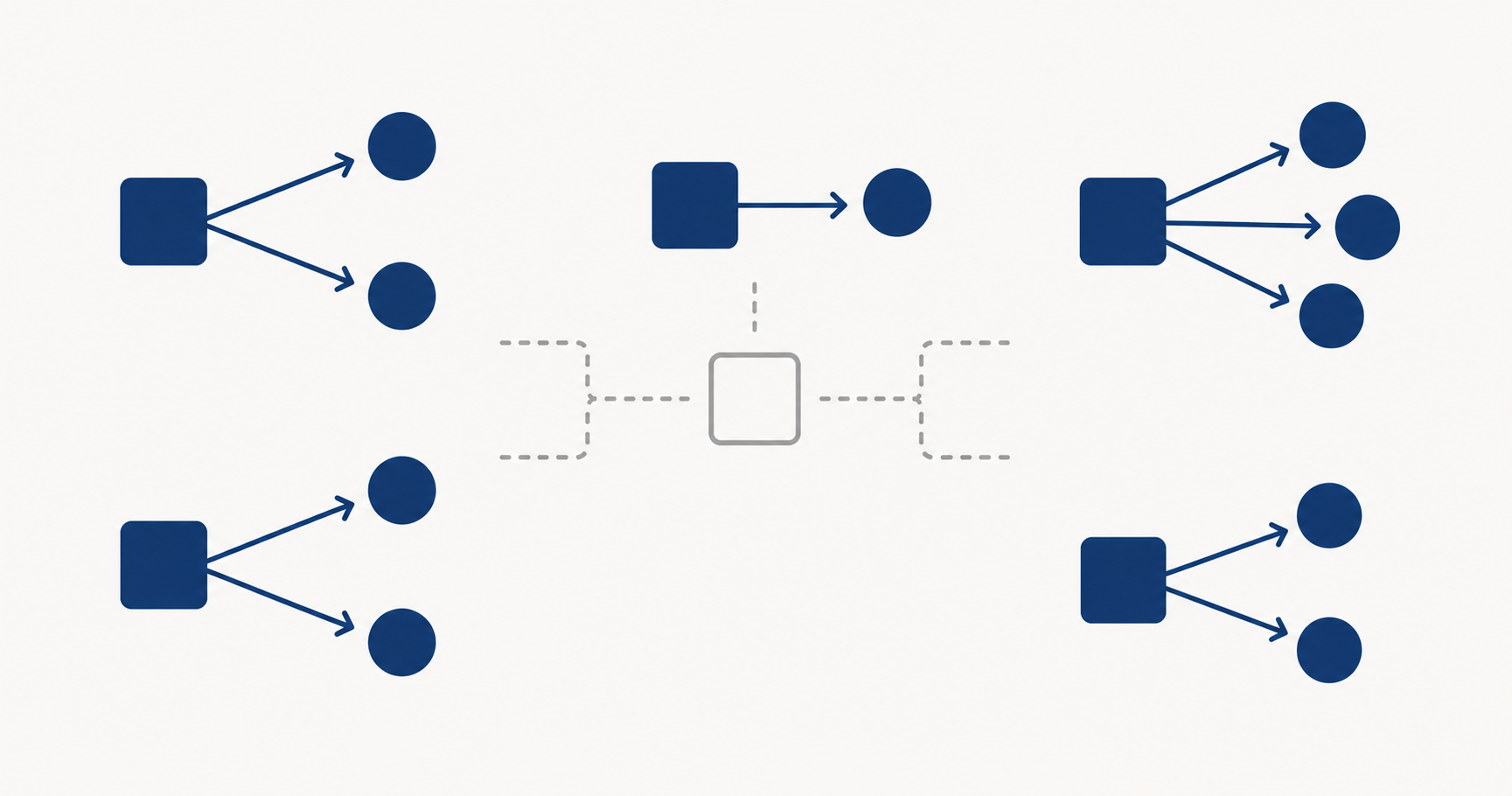

Todo modelo tem um ciclo de vida: concepção, desenvolvimento, validação, deploy, monitoramento, retreinamento ou desativação.

O risco de IA Orphan mora na transição entre deploy e monitoramento.

Na maioria das empresas, o deploy marca o fim do projeto. O modelo foi entregue. O time comemora. O chamado fecha. A documentação vai para uma pasta que ninguém vai abrir.

O que começa no deploy é a fase mais longa e a mais negligenciada: a operação.

Modelo em operação precisa de responsável, precisa de monitoramento de performance, precisa de gatilho para intervenção quando o comportamento muda. Sem isso, o ciclo de vida do modelo termina no deploy na prática — mas não na realidade, porque o modelo continua funcionando.

Quando a ANPD ou um auditor de ISO 42001 pergunta "quem é responsável por esse modelo?", a resposta "o time de dados" não é suficiente. Precisa de nome, cargo, e-mail e evidência de que essa pessoa monitora ativamente.

Como identificar na sua empresa (checklist de 4 itens)

Para cada modelo em produção na sua empresa, verifique:

1. Existe um responsável nomeado?

Nome, cargo, e-mail. Se a resposta for "a área de dados" ou "o fornecedor", o modelo é candidato a órfão.

2. Existe documentação de comportamento esperado?

Não documentação técnica de arquitetura. Documentação de comportamento: quais decisões o modelo toma, com quais critérios, com qual performance esperada, com quais limitações conhecidas.

3. Houve avaliação de performance nos últimos 90 dias?

Se a última avaliação documentada foi no deploy, o modelo está operando sem supervisão ativa.

4. Existe critério definido para desativar o modelo?

Se não há threshold de degradação que dispara retreinamento ou desativação, ninguém vai desligar o modelo — mesmo quando ele estiver tomando decisões erradas.

Quatro "nãos" indicam IA Orphan confirmada.

Dois ou três "nãos" indicam governança parcial — que é risco menor, mas ainda é risco.

O que fazer depois de identificar

O primeiro passo não é técnico. É organizacional.

Nomeie um responsável. Para cada modelo órfão identificado, designa alguém com autoridade para monitorar, retreinar e desativar. Coloca isso em documento formal, não em conversa de corredor.

Faça uma auditoria rápida de comportamento. O modelo está tomando as decisões que deveria? Compare outputs recentes com o critério original de aceite. Se não tem critério original documentado, esse é o primeiro problema a resolver.

Decida: mantém ou desativa. Modelo que não tem dono e não tem justificativa de negócio ativa deve ser desativado. Manter modelo rodando sem razão é exposição sem benefício.

Implante monitoramento mínimo. Para os modelos que ficam: log de decisões, alerta de degradação de performance, revisão trimestral documentada. Mínimo, não complexo.

A ISO 42001 exige que sistemas de IA em produção tenham owner identificado e processo de revisão periódica. Não é pedido razoável de auditoria. É requisito de certificação.

Empresa que quer certificação sem inventário de modelos não chega na fase 2 da auditoria.

Algum modelo na sua empresa está tomando decisões agora sem que ninguém saiba exatamente o que ele decide.

Isso não é hipótese. É probabilidade estatística em qualquer empresa com mais de 3 anos de adoção de IA.

O checklist identifica se sua empresa tem sistemas sem dono documentado: risco.ia.br/checklist.

O score mostra a dimensão da exposição: alc.ia.br/score-risco.

O kit traz o template de designação de AI Owner pronto para adaptar: alc.ia.br/kit.

Para fechar tudo com plano: alc.ia.br/diagnostico.