Seu modelo de crédito negou um cliente.

Seu sistema de RH filtrou um candidato.

Seu algoritmo de precificação cobrou mais de alguém.

Uma pergunta simples: você consegue explicar por quê?

Não em termos técnicos. Em termos que um juiz — ou a ANPD — aceite como resposta.

Se a resposta é não, você tem um passivo aberto.

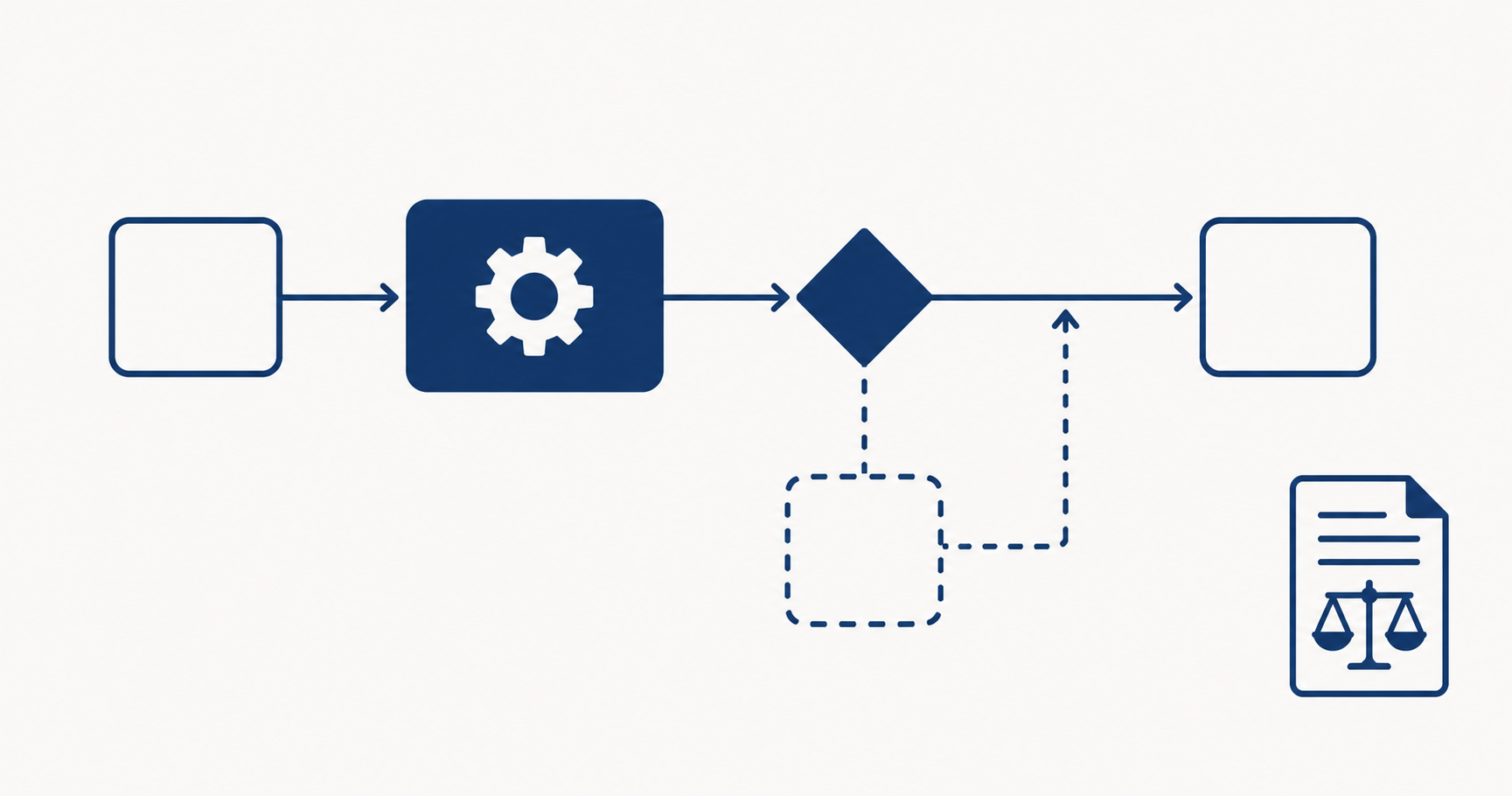

O que o Art. 20 determina (e a maioria ignora)

O Art. 20 da LGPD é direto:

"O titular dos dados tem direito a solicitar a revisão de decisões tomadas unicamente com base em tratamento automatizado de dados pessoais que afetem seus interesses."

Três palavras importam: revisão, unicamente e afetem.

Revisão não é só estornar uma decisão. É explicar o critério que gerou aquela decisão para aquela pessoa específica.

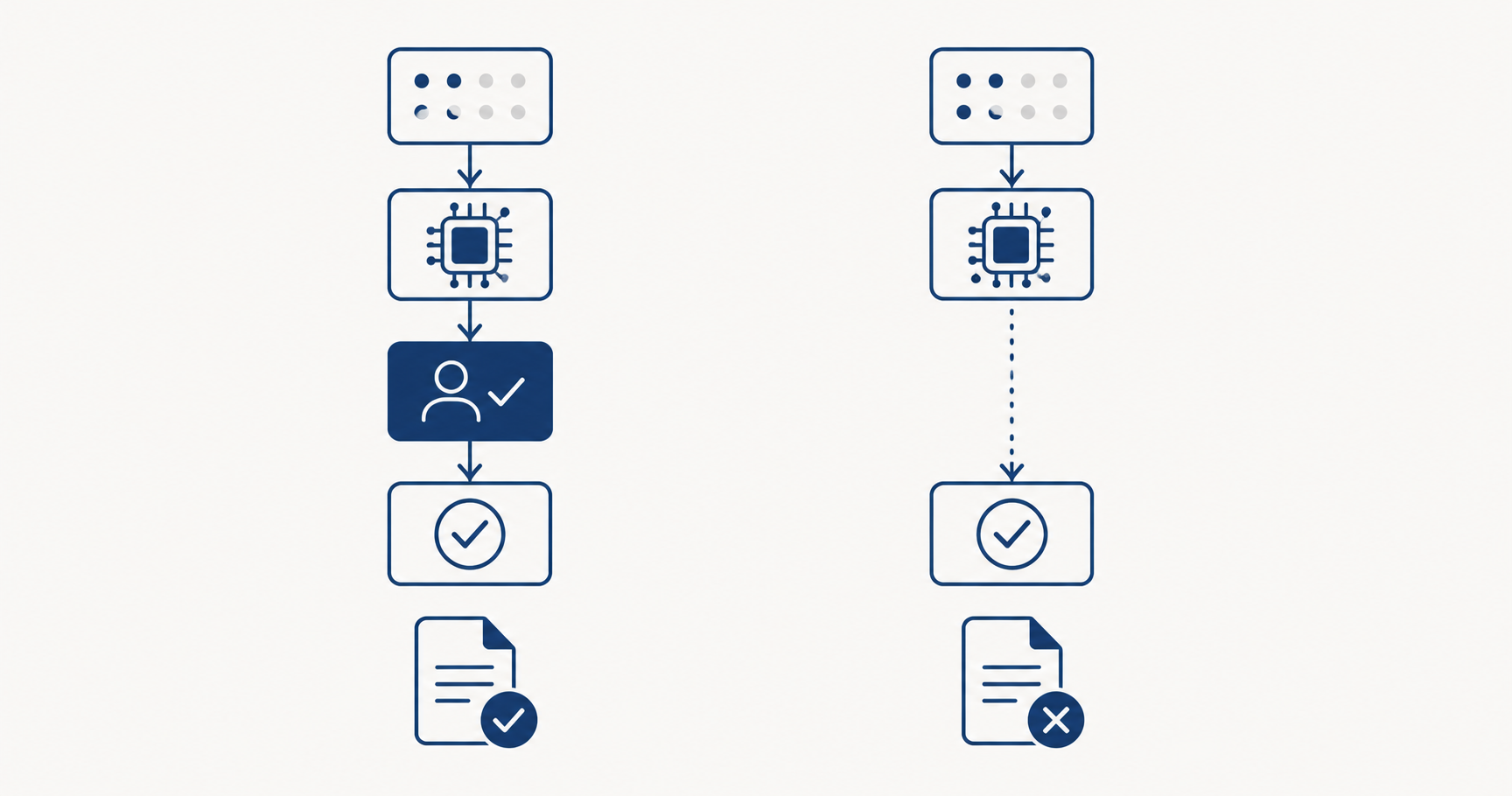

Unicamente significa que, se o modelo toma a decisão sem supervisão humana real, o Art. 20 se aplica. Humano que apenas homologa sem analisar não conta.

Afetem é amplo de propósito. Crédito, contratação, seguro, precificação dinâmica, acesso a serviço — tudo se enquadra.

A maioria das empresas leu o artigo uma vez e arquivou. Ninguém montou o processo de resposta. Ninguém mapeou quais sistemas disparam a obrigação.

Quais sistemas se enquadram

Não é só o modelo de crédito. A lista é mais longa do que parece.

Sistemas de crédito e cobrança: score de inadimplência, limite automático, bloqueio de conta.

RH e recrutamento: triagem automática de currículos, ranking de candidatos, análise de fit cultural por NLP.

Precificação dinâmica: qualquer algoritmo que cobra preços diferentes para pessoas diferentes.

Atendimento e priorização: filas de atendimento definidas por score de valor do cliente.

Saúde e seguros: modelos de risco que definem cobertura, franquia ou recusa.

Se o sistema toma uma decisão que muda o que a pessoa recebe — produto, preço, acesso, oportunidade — ele está no escopo do Art. 20.

Sua empresa tem esse controle hoje?

Faça o checklist em 5 minutos — gratuito.

Baixar checklist gratuitoO que "explicar o critério" exige na prática

"O modelo usa machine learning" não é explicação. É esquiva.

O que a ANPD espera — e o que qualquer processo judicial vai exigir — é:

Quais variáveis entraram na decisão. Não a lista completa de features do modelo. As variáveis que pesaram naquela decisão, para aquele indivíduo.

Qual o peso relativo de cada uma. Se idade respondeu por 40% do score e histórico de pagamento por 20%, isso precisa estar documentado.

Qual o critério de corte. Por que 620 pontos aprova e 619 nega? Quem definiu esse limiar? Quando foi revisado pela última vez?

Qual a lógica de revisão. Se o titular pede revisão, quem analisa? Com qual prazo? Com qual critério de override?

Modelos caixa-preta — redes neurais profundas sem camada de explicabilidade — não conseguem responder isso. Não é limitação técnica que você resolve depois. É escolha arquitetural que cria passivo jurídico hoje.

O risco de viés como violação LGPD

O Art. 20 tem um parágrafo que a maioria não leu até o fim.

O § 3º veda "decisões discriminatórias ilícitas ou abusivas" tomadas por sistemas automatizados.

Discriminação, na leitura da ANPD e do Judiciário, não exige intenção. Basta efeito desproporcional sobre grupo protegido.

Se seu modelo de crédito nega proporcionalmente mais para mulheres, para negros ou para moradores de determinados CEPs — sem que isso seja justificado por critério legítimo e proporcional — você tem violação de LGPD, não só problema ético.

O risco não é hipotético. O CFPB nos EUA aplicou multas superiores a USD 2 bilhões contra instituições financeiras por discriminação algorítmica entre 2021 e 2024. A ANPD tem base legal para seguir o mesmo caminho.

Como se adequar em 3 passos

Passo 1: inventário de sistemas no escopo.

Mapeie todos os sistemas que tomam decisões automatizadas afetando pessoas. Coloque nome, responsável, tipo de modelo e data da última auditoria. Se você não tem esse inventário, começa por aqui.

Passo 2: implante explicabilidade antes do deploy.

Para modelos já em produção: adicione camada de XAI — SHAP, LIME ou similar — que gera explicação por decisão individual. Armazene junto ao registro da decisão.

Para modelos novos: isso entra como requisito de aceite. Modelo que não tem mecanismo de explicação não vai para produção.

Passo 3: construa o processo de revisão.

Quem recebe o pedido, em qual canal. Qual o prazo de resposta (a LGPD não fixa, mas 15 dias úteis é referência razoável). Quem tem poder de override. Como a decisão de revisão é documentada.

Esse processo precisa estar escrito, testado e com responsável nomeado.

Seu modelo toma decisões que afetam pessoas todos os dias.

A pergunta não é se o Art. 20 se aplica à sua empresa.

A pergunta é se você tem como responder quando alguém perguntar.

Comece pelo checklist — ele inclui os pontos específicos do Art. 20: risco.ia.br/checklist.

Se quiser medir a exposição real da empresa em 8 dimensões: alc.ia.br/score-risco.

E para fechar os gaps com plano e prazo definido: alc.ia.br/diagnostico.