Quando o assunto é viés em algoritmos, a conversa escorrega para ética.

Inclusão, diversidade, responsabilidade social.

Isso é um erro de enquadramento — e caro.

Viés algorítmico é passivo financeiro. É risco regulatório mensurável. É exposição jurídica com base legal já estabelecida no Brasil e na Europa.

Empresa que trata o tema como agenda de ESG deixa de fazer a análise de risco que protege o balanço.

Por que viés é passivo financeiro (não questão de ética)

Em 2022, o Bank of America pagou USD 12 milhões para resolver investigação do CFPB sobre discriminação algorítmica em aprovação de hipotecas. O algoritmo negava proporcionalmente mais empréstimos para tomadores negros e hispânicos — sem que isso fosse intencional.

Em 2023, o Apple Card foi investigado pelo Departamento de Serviços Financeiros de Nova York. Clientes reportaram que o limite de crédito da esposa era sistematicamente menor que o do marido, mesmo com histórico financeiro idêntico.

Em 2024, a Comissão Europeia abriu processo contra plataforma de recrutamento por discriminação algorítmica por gênero. Mulheres recebiam menos oportunidades de emprego em áreas técnicas.

Três casos, três jurisdições, três setores diferentes. Um padrão comum: o viés não foi intencional. O viés estava nos dados. O custo foi real.

No Brasil, a LGPD dá base para o mesmo tipo de exposição. O EU AI Act — com aplicação a empresas que operam na Europa, mesmo que sediadas fora — vai ampliar isso.

Viés algorítmico não é problema de imagem. É linha no orçamento de risco que a maioria ainda não abriu.

De onde vem o viés — 4 origens em linguagem de negócio

Viés de dados históricos. O modelo aprendeu com decisões humanas passadas. Se essas decisões eram discriminatórias, o modelo replica o padrão — com eficiência e escala. Modelo de crédito treinado com histórico de aprovações de banco que sistematicamente negava crédito para determinados bairros vai perpetuar a mesma lógica. Só que mais rápido e sem que ninguém perceba.

Viés de seleção amostral. O modelo foi treinado com dados que não representam quem ele vai avaliar. Modelo de triagem de currículos treinado com histórico de contratações de empresa que contratou majoritariamente homens brancos vai penalizar perfis que se desviam desse padrão.

Viés de proxy. O modelo não usa explicitamente raça, gênero ou origem. Usa CEP, histórico de emprego, escola de graduação. Essas variáveis correlacionam com características protegidas. O resultado discriminatório aparece mesmo sem a variável protegida no modelo.

Viés de feedback loop. O modelo aprova crédito para quem tem perfil A. Só quem tem perfil A toma crédito. Só quem toma crédito gera dado de repagamento. Novos dados de treino reforçam o modelo original. O loop fecha e o viés se aprofunda ao longo do tempo.

Sua empresa tem esse controle hoje?

Faça o checklist em 5 minutos — gratuito.

Baixar checklist gratuitoLGPD Art. 20 e EU AI Act como drivers regulatórios

A LGPD não usa a palavra "viés". Mas o Art. 20, § 3º é direto ao ponto:

São vedadas as decisões automatizadas que impliquem tratamento discriminatório ilícito ou abusivo com base em atributos como raça, gênero, convicção política, estado de saúde e condição social.

Discriminação, na interpretação jurídica majoritária, não exige intenção. Exige efeito desproporcional sobre grupo protegido.

Se seu modelo de crédito nega proporcionalmente mais para mulheres, você tem violação — independente de o modelo ter sido construído sem essa intenção.

O EU AI Act vai mais longe. Para sistemas de alto risco — crédito, emprego, saúde, serviços essenciais — exige testes de fairness documentados antes do deploy. Exige monitoramento contínuo de discriminação. Exige registro auditável dos testes realizados.

Empresa brasileira que opera na Europa, vende para europeus ou processa dados de cidadãos europeus está no escopo. Não é discussão futura. O EU AI Act entrou em vigência em agosto de 2024.

O custo de testar depois vs testar antes

Testar fairness antes do deploy é barato. Caro é descobrir viés depois.

Antes do deploy: análise de fairness com ferramentas como Fairlearn, AI Fairness 360 ou IBM OpenScale leva de 3 a 10 dias dependendo da complexidade do modelo. O custo é de consultoria especializada — na casa de dezenas de milhares de reais.

Depois que o problema aparece: investigação regulatória, custo jurídico, remediação da carteira afetada, relook de contratos firmados com critério enviesado, dano de marca em segmento sensível. Nenhum desses itens custa menos que seis dígitos. A maioria passa de sete.

A lógica é a mesma de qualquer controle preventivo. O custo de testar antes é fixo e previsível. O custo de remediar depois é variável e não tem teto.

Testes de fairness como controle auditável

Teste de fairness não é auditoria moral. É procedimento técnico com metodologia estabelecida, output documentável e critério de aceite definido.

As principais métricas de fairness para sistemas de crédito e seleção:

Demographic parity: a taxa de aprovação é similar entre grupos protegidos? Um modelo de crédito com 70% de aprovação para homens e 45% para mulheres com perfis equivalentes falha nessa métrica.

Equal opportunity: entre os candidatos que deveriam ser aprovados (bons pagadores, candidatos qualificados), a taxa de aprovação é igual entre grupos? Falha aqui indica que o modelo está penalizando grupos específicos mesmo quando o critério objetivo favorece a aprovação.

Calibration: o score do modelo significa a mesma coisa para grupos diferentes? Um score 650 deve indicar a mesma probabilidade de inadimplência para todos os grupos demográficos.

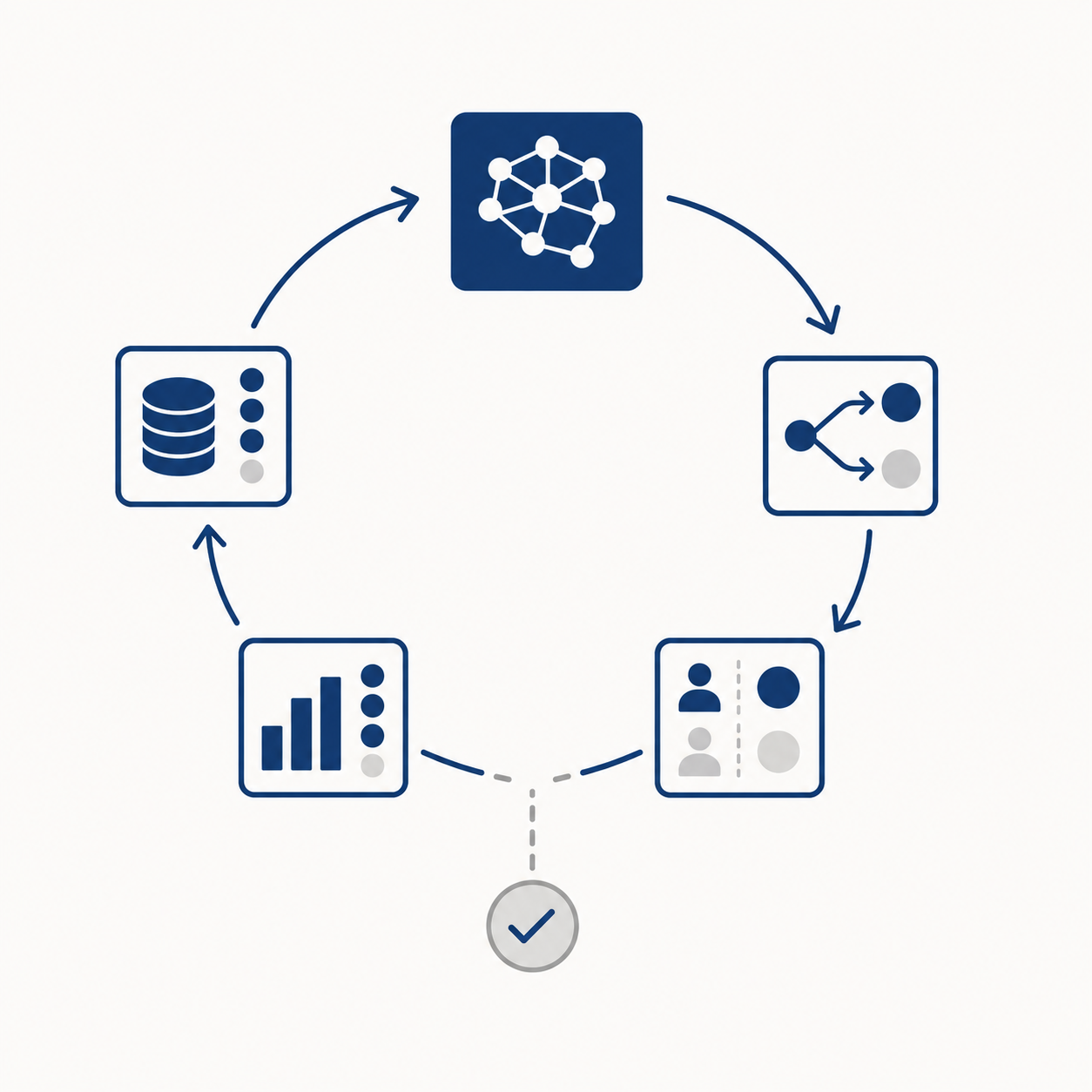

Para ser auditável, o teste precisa de:

- Dataset de avaliação separado do dataset de treino

- Registro das métricas no momento do deploy

- Frequência de reavaliação definida (trimestral é mínimo razoável)

- Critério explícito de o que constitui falha e o que acontece quando falha

Esse registro é o que você apresenta para a ANPD, para o auditor de ISO 42001 ou para o juiz.

Sem registro, o teste não aconteceu — do ponto de vista legal e regulatório.

Viés no seu modelo não está esperando você descobrir.

Está gerando decisões agora.

O que está esperando é o momento em que alguém vai calcular o custo.

O checklist identifica se sua empresa tem os controles básicos de viés documentados: risco.ia.br/checklist.

Para medir a exposição completa: alc.ia.br/score-risco.

Para o plano de ação com prioridades: alc.ia.br/diagnostico.