Você não contratou IA. Contratou um CRM, uma ferramenta de suporte, um sistema de RH.

Mas esses sistemas foram atualizados. Silenciosamente. E agora têm modelos de linguagem, análise preditiva ou automação baseada em ML embutidos.

Você não assinou um adendo. Não houve aprovação jurídica. Ninguém do compliance foi consultado.

O dado dos seus clientes está alimentando um modelo de terceiro — e você não sabe desde quando.

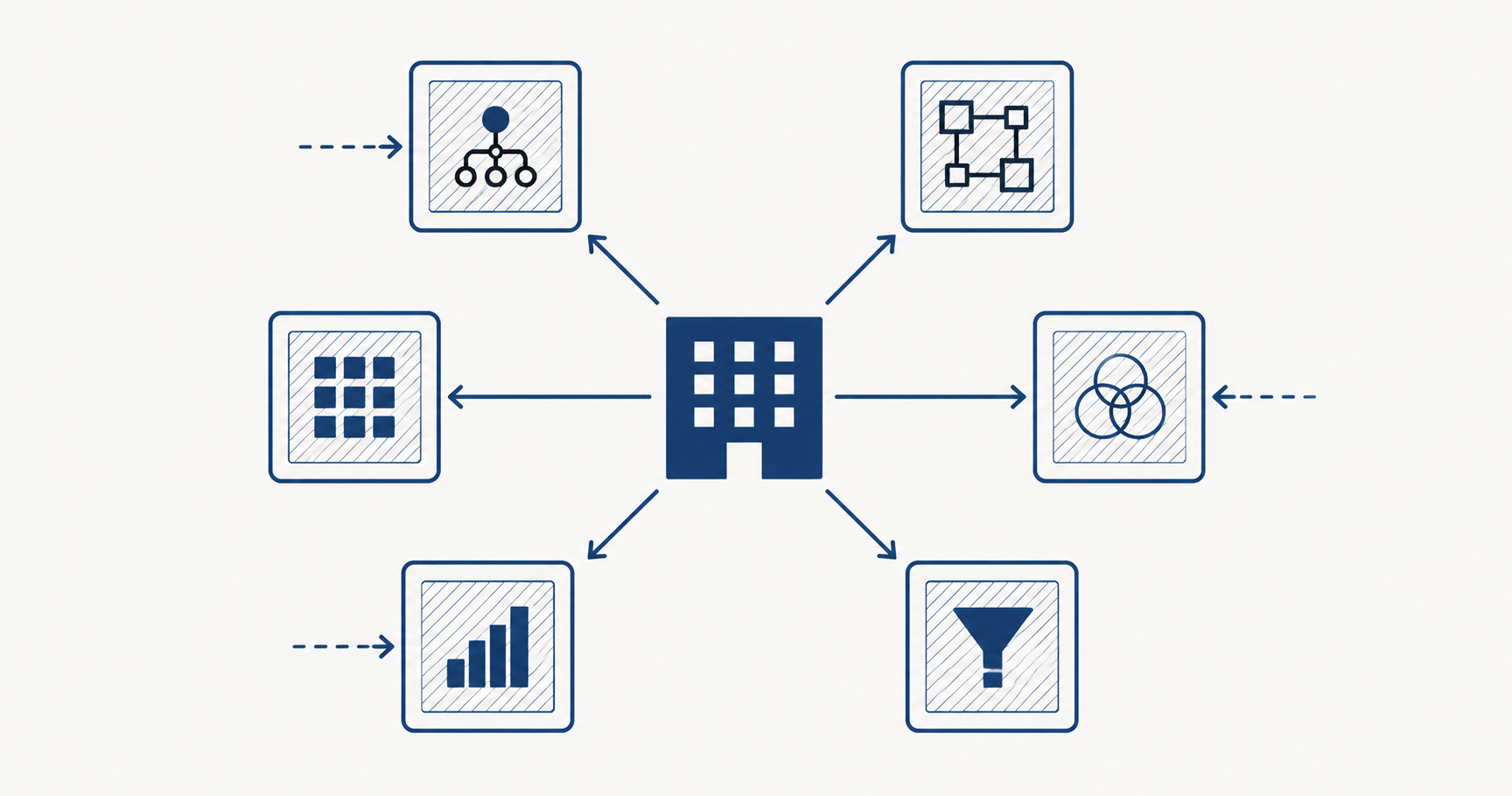

Como IA entra pela porta dos fundos — via SaaS contratado

A maioria das organizações tem processos razoáveis para contratar IA como projeto formal.

Aprovação de budget, análise de fornecedor, revisão de contrato, às vezes um DPO envolvido.

O problema não está nos projetos de IA. Está nos SaaS já aprovados que adicionam IA sem avisar.

Salesforce lançou o Einstein AI como feature padrão para contas existentes. HubSpot adicionou scoring preditivo e sugestão de conteúdo baseada em ML. Zendesk integrou classificação automática de tickets com modelos de linguagem. Workday implementou análise preditiva de turnover como módulo padrão.

Nenhum desses exemplos exigiu novo contrato. Em muitos casos, o recurso foi habilitado por padrão — sem comunicação ativa ao cliente.

O dado que você inseriu no sistema ontem está sendo processado por um modelo que você nunca avaliou.

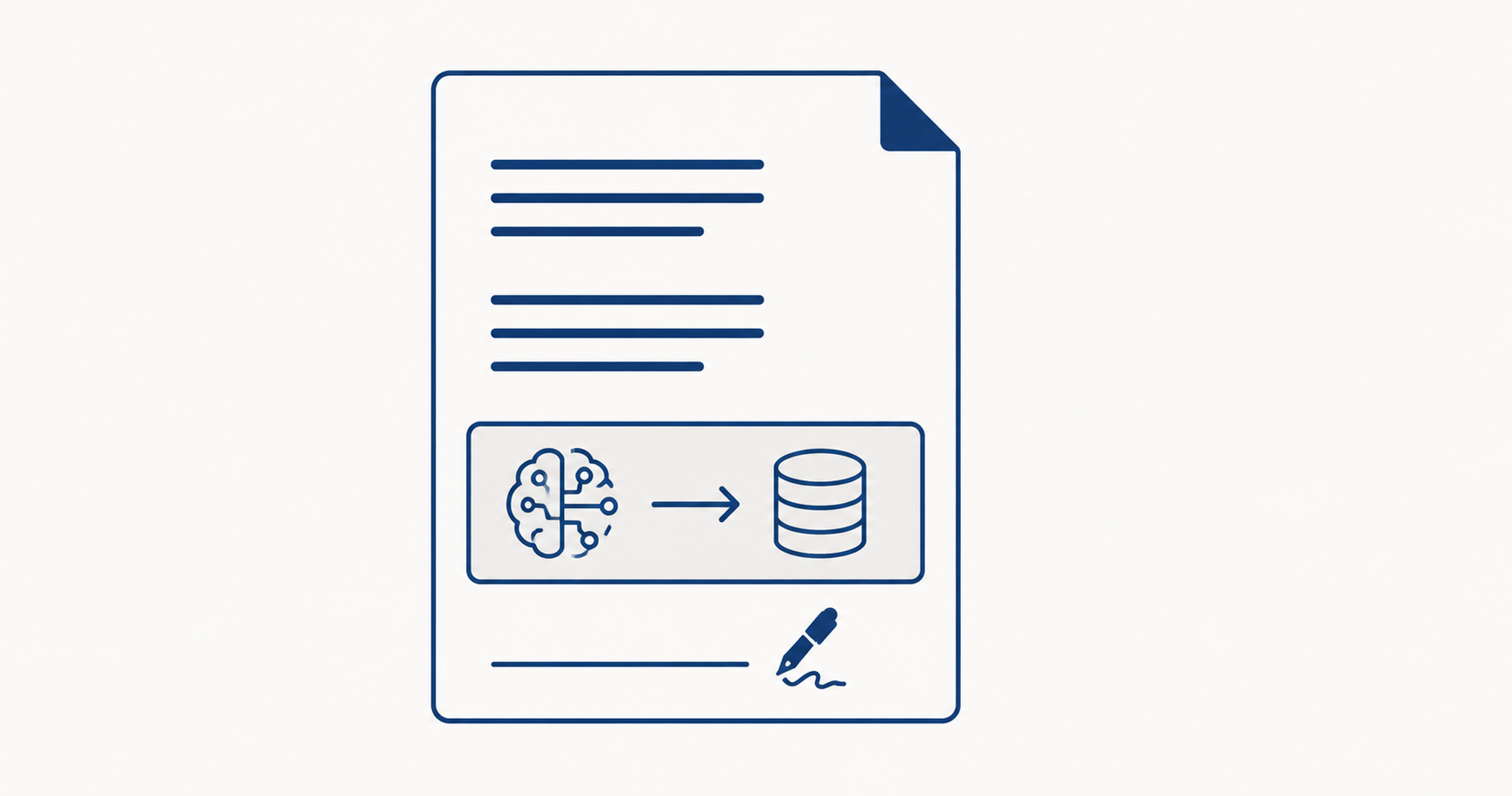

O que mudou nos últimos 2 anos nos contratos de software

Até 2022, contratos de SaaS corporativo tinham cláusulas de IA como exceção. Quando existiam, eram específicas — identificava exatamente qual funcionalidade usava ML.

Entre 2023 e 2025, o padrão mudou radicalmente.

A maioria dos contratos de SaaS enterprise hoje inclui cláusulas genéricas que autorizam uso de dados para "melhoria do produto", "personalização de experiência" ou "desenvolvimento de funcionalidades futuras". Essas cláusulas cobrem treinamento de modelos.

Alguns contratos adicionaram seções específicas de IA com linguagem que transfere a responsabilidade de conformidade para o cliente: "o cliente é responsável por garantir que o uso das funcionalidades de IA esteja em conformidade com as leis aplicáveis".

Traduzindo: o fornecedor vende a IA, mas a exposição regulatória é sua.

Quem revisou o contrato do seu CRM depois da última atualização de termos? Provavelmente ninguém.

Qual é o nível de exposição da sua empresa?

Score de risco em 8 perguntas — resultado imediato.

Fazer o score de riscoComo identificar IA embutida antes de assinar o contrato

Três perguntas que precisam entrar no processo de aprovação de qualquer SaaS:

1. O produto usa ou planeja usar inteligência artificial ou machine learning?

Não pergunte de forma genérica. Peça lista das funcionalidades que usam IA, mesmo que opcionais. Peça a data de quando cada uma foi introduzida.

2. Dados de clientes da minha empresa são usados para treinar modelos?

Muitos fornecedores distinguem entre "dados usados para personalização do produto" e "dados usados para treinamento de modelos compartilhados". Essa distinção é crítica. Um é customização para você. O outro é contribuição para um modelo que outros clientes também usam.

3. Como o produto notifica clientes sobre adição de novas funcionalidades de IA?

Se a resposta for "está nos termos de uso" ou "no changelog", você não tem controle. Você precisa de notificação ativa com prazo razoável para revisão.

Essas perguntas não são hostis. São devidas. Fornecedores sérios respondem sem hesitação.

O risco de dados de clientes em treinamento de modelo de terceiro

Quando dados dos seus clientes entram no treinamento de um modelo de terceiro, três riscos surgem simultaneamente:

Risco de LGPD. Treinamento de modelo com dados pessoais é tratamento de dados. Exige base legal, finalidade específica e — dependendo do dado — consentimento ou legítimo interesse documentado. Se o fornecedor está treinando com seus dados sem que você tenha verificado a base legal, a responsabilidade pode ser sua junto ao titular.

Risco de vazamento indireto. Modelos treinados com dados específicos podem, em certas condições, "vazar" informações de treinamento em outputs para outros usuários. Isso não é teórico — foi demonstrado em pesquisas com modelos de linguagem desde 2021. Dado de cliente seu pode emergir em resposta para cliente de outro usuário do mesmo SaaS.

Risco de perda de controle sobre dado sensível. Uma vez que o dado entra no modelo de terceiro, você perdeu o controle sobre onde ele vive e por quanto tempo. Exclusão do dado na plataforma não garante que ele foi removido do modelo treinado.

Esses três riscos existem mesmo quando o fornecedor é confiável e bem-intencionado. Existem por arquitetura, não por má-fé.

O processo mínimo para avaliar fornecedores com IA

Não é necessário um processo complexo. Mas precisa ser sistemático.

Antes de assinar:

- Questionário de IA obrigatório para qualquer SaaS que processe dados de clientes ou colaboradores

- Revisão da cláusula de uso de dados pelo jurídico com foco específico em treinamento de modelos

- Classificação do fornecedor por nível de risco: qual dado processa, que volume, que sensibilidade

No contrato:

- Cláusula explícita proibindo uso de dados para treinamento de modelos compartilhados, ou com consentimento documentado se autorizado

- Obrigação de notificação ativa para introdução de novas funcionalidades de IA com prazo de opt-out

- Direito de auditoria sobre como os dados são processados por funcionalidades de IA

Na operação:

- Revisão anual dos termos dos principais fornecedores de SaaS

- Processo para tratar atualizações de termos — não deixar para o time de TI arquivar sem leitura

Isso não elimina o risco. Mas cria um registro documentado de diligência — que é o que reguladores e auditores vão pedir quando algo der errado.

Shadow AI via SaaS é o risco que ninguém está monitorando porque não parece ser um projeto de IA.

É. Só que sem o controle que um projeto formal teria.

O score de risco avalia a exposição nos fornecedores críticos: alc.ia.br/score-risco.

Para o diagnóstico completo com plano de revisão contratual e controles: alc.ia.br/diagnostico.