A maioria das empresas trava no começo.

Não por falta de intenção. Por falta de estrutura para dar o primeiro passo sem abrir um projeto de 6 meses com comitê, workstream e entrega em PowerPoint de 80 slides.

O resultado é zero governança enquanto os sistemas de IA continuam sendo contratados, expandidos e integrados com dados de clientes.

Governança de IA não precisa começar grande. Precisa começar.

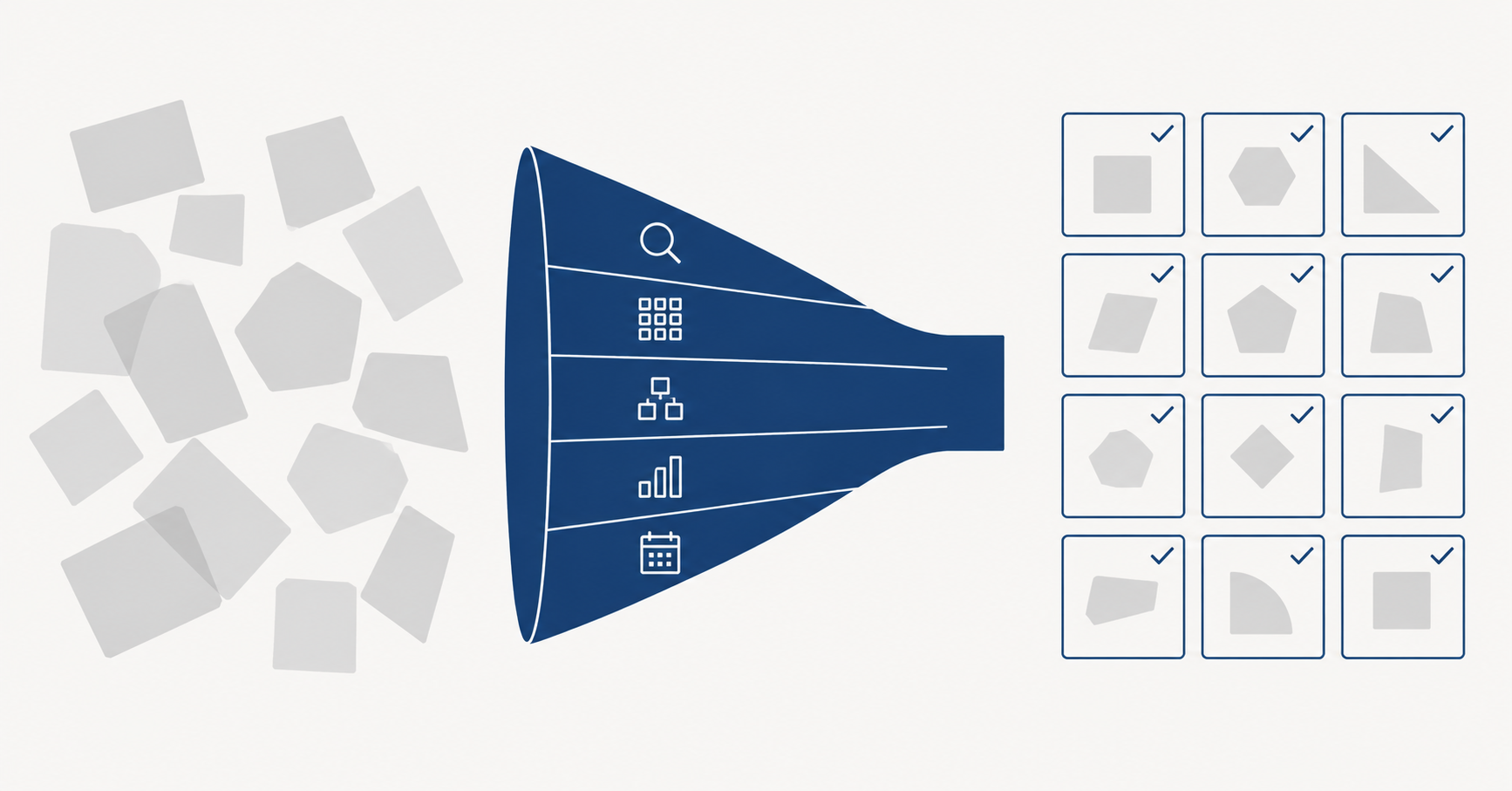

O Método CLEAR AI foi desenhado para isso: saída estruturada em 5 dias úteis, com entregáveis que servem de base para qualquer framework — incluindo ISO 42001.

Por que governança de IA não precisa demorar meses

A crença de que governança é sinônimo de projeto longo vem de experiências com ISO 27001 e SOC 2 — normas que exigem meses de implementação e evidências operacionais.

ISO 42001 também exige maturidade para certificação. Mas certificação não é o primeiro passo.

O primeiro passo é saber o que você tem.

Qual IA está rodando na empresa? Quem contratou? Quem é o dono operacional? Que dados ela processa? Que decisão ela influencia?

Sem resposta para essas perguntas, qualquer política de IA é decoração.

O Método CLEAR AI ataca exatamente esse ponto cego. Em 5 dias, você tem clareza — e um ponto de partida real.

C — Clareza: onde a IA está na empresa

O primeiro dia é de mapeamento.

Não é uma reunião de kickoff com stakeholders. É uma coleta estruturada de informações: sistemas contratados, ferramentas usadas por área, integrações com dados internos.

A maioria das empresas se surpreende aqui.

O time de marketing usa IA generativa para copy sem passar pelo jurídico. O RH contratou uma ferramenta de triagem de currículos com modelo embutido. O financeiro usa um SaaS de previsão de demanda que foi atualizado para incluir ML sem que ninguém fosse avisado.

Clareza não é só sobre os projetos formais de IA. É sobre tudo que processa informação de forma automatizada com influência em decisões.

Sem esse mapa, você está gerindo o que não conhece — que é a definição de risco não controlado.

Pronto para estruturar a governança de IA?

Diagnóstico completo: inventário, matriz de risco, plano 30/60/90 dias.

Agendar diagnósticoL — Levantamento: classificação de risco por sistema

Com o inventário em mãos, o segundo passo é classificar.

Não todo sistema de IA tem o mesmo perfil de risco. Uma IA que sugere produtos em e-commerce tem risco diferente de uma que analisa crédito, triagem de candidatos ou detecção de fraudes.

O Levantamento aplica uma matriz de criticidade com 4 dimensões:

- Impacto sobre pessoas: o sistema toma ou influencia decisões que afetam indivíduos identificáveis?

- Dados sensíveis: processa dados pessoais, financeiros, de saúde ou comportamentais?

- Autonomia de decisão: humano ainda revisa, ou o sistema decide sozinho?

- Escala: quantas decisões por dia? Quantos usuários afetados?

O resultado é uma classificação por nível — baixo, médio, alto, crítico.

Sistemas críticos precisam de controles imediatos. Sistemas baixos podem esperar.

Sem essa classificação, você aplica o mesmo esforço de controle para tudo — e não controla nada bem.

E — Estrutura: os 5 controles mínimos

Para cada sistema classificado como médio ou acima, existem 5 controles que precisam existir antes de qualquer política formal:

1. Dono identificado. Uma pessoa física responsável pelo sistema. Não o fornecedor. Não a área de TI genericamente. Uma pessoa com nome.

2. Finalidade documentada. Para que esse sistema existe? Que decisão ele suporta? Escrito, não apenas lembrado.

3. Dados de entrada catalogados. Quais dados entram no modelo? Quem autorizou o uso desses dados para esse fim?

4. Processo de revisão humana. Para outputs de alto impacto, há revisão? Quem revisa? Com que frequência?

5. Registro de incidentes. Se o sistema errar, existe um canal para reportar? Alguém vai saber?

Esses 5 controles não certificam ninguém em nada. Mas fecham as janelas mais óbvias de risco operacional e regulatório.

Uma empresa que tem esses 5 controles para seus sistemas de IA está muito à frente de 90% do mercado brasileiro.

A + R — Análise de gap e roteiro 30/60/90

Com inventário, classificação e controles mínimos identificados, as duas últimas etapas são:

Análise de gap: confrontar o estado atual com o que a ISO 42001 e o contexto regulatório (LGPD, AI Act para exportadores, regulamentação setorial) exigem. Onde estão as lacunas? Quais são críticas agora? Quais podem esperar?

Roteiro 30/60/90: um plano de ação com prioridade, responsável e prazo. Não um documento de intenções — uma lista de tarefas com dono.

Em 30 dias: fechar os controles mínimos dos sistemas críticos.

Em 60 dias: documentar a política de IA corporativa com base no inventário real.

Em 90 dias: ter o sistema de gestão básico operando — com reuniões de revisão, registro de incidentes e processo de avaliação de novos sistemas antes da contratação.

Esse roteiro é o ponto de partida para quem quer a ISO 42001. É também o mínimo para quem não quer a certificação mas precisa demonstrar governança para clientes, auditores ou reguladores.

O Método CLEAR AI não substitui a implementação completa. Ele elimina o motivo pelo qual a maioria das empresas nunca começa: não saber por onde começar.

5 dias. Inventário, risco, controles mínimos, gap, roteiro.

Isso já é mais do que a maioria tem.

Comece com o diagnóstico: alc.ia.br/diagnostico