Em 2005, pouquíssimas empresas tinham ISO 27001.

Era diferencial competitivo. Sinal de maturidade. Algo que empresa grande fazia para impressionar cliente maior ainda.

Em 2015, grandes compradores começaram a exigir como requisito de contrato. Quem não tinha, ficava fora da RFP.

Em 2025, empresa que vende para setor financeiro, saúde ou governo sem ISO 27001 não entra no processo. Ponto.

A ISO 42001 está no mesmo início de ciclo. Quem entender isso agora tem vantagem. Quem esperar vai correr atrás.

O que é ISO 42001 — não é curso, não é software

ISO 42001 é um Sistema de Gestão de IA.

Publicada em dezembro de 2023, é o padrão da ISO para que organizações estabeleçam, implementem, mantenham e melhorem continuamente a governança dos seus sistemas de IA.

Não é um treinamento sobre inteligência artificial. Não é uma plataforma de monitoramento. Não é uma lista de boas práticas.

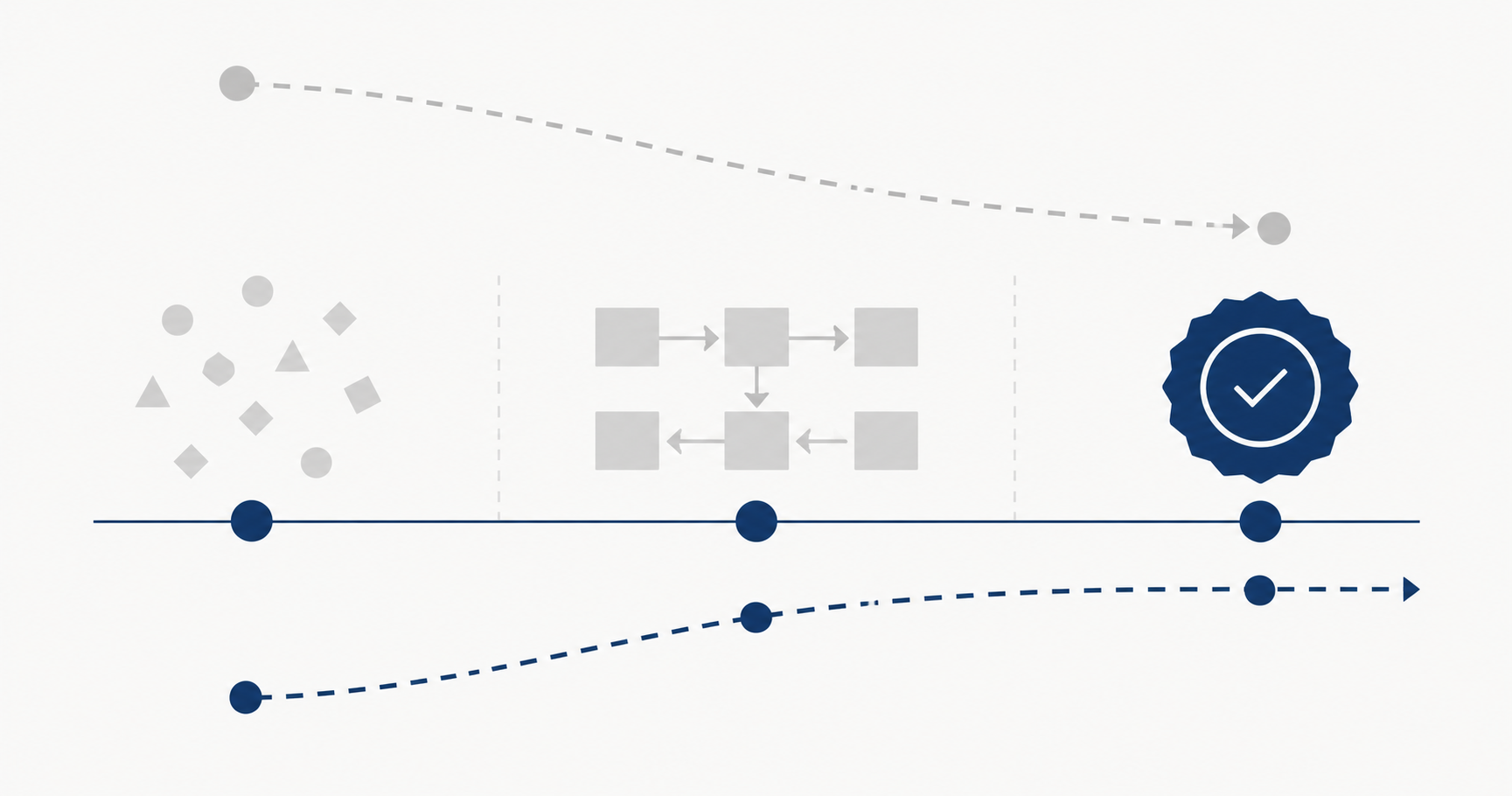

É uma estrutura de gestão — com política, processos, controles, responsabilidades, evidências e auditoria. O mesmo modelo lógico da ISO 9001 (qualidade), da ISO 27001 (segurança da informação) e da ISO 14001 (meio ambiente).

Empresas que já têm ISO 27001 vão reconhecer a arquitetura. Os requisitos de contexto organizacional, liderança, planejamento, suporte, operação, avaliação de desempenho e melhoria — é a estrutura de alto nível que a ISO usa para todos os sistemas de gestão.

O que é específico de IA: avaliação de impacto de sistemas de IA, gestão de viés, transparência algorítmica, rastreabilidade de dados de treinamento, designação de AI Owner.

Por que vai seguir o mesmo caminho da ISO 27001

Três forças estão empurrando nessa direção.

Regulação. O EU AI Act entrou em vigor em 2024. Empresas que usam sistemas de IA de alto risco precisam demonstrar conformidade. A ISO 42001 é o instrumento natural de demonstração — assim como a ISO 27001 é o instrumento para demonstrar controles de segurança.

Pressão de cadeia de fornecimento. Grandes empresas globais — bancos, seguradoras, varejistas — estão começando a incluir cláusulas de governança de IA em contratos com fornecedores. A pergunta "você tem política de IA e controles documentados?" já aparece em questionários de due diligence em setores como fintech, healthtech e logística.

Risco reputacional. Um incidente de IA — decisão discriminatória, vazamento via prompt, output causando dano — expõe a empresa inteira. Ter um sistema de gestão certificado não elimina o risco, mas documenta o processo de controle. Isso faz diferença em investigação regulatória e em litígio.

Essas três forças se combinam. Não é tendência — é movimento em curso.

Qual é o nível de exposição da sua empresa?

Score de risco em 8 perguntas — resultado imediato.

Fazer o score de riscoAs 3 perguntas que você vai precisar responder

Quando a ISO 42001 virar exigência contratual no seu setor, três perguntas vão aparecer:

"Quais sistemas de IA a empresa usa e quem é responsável por cada um?"

Sem inventário de IA e sem AI Owners designados, não tem resposta. E sem resposta, não tem contrato.

"Como vocês avaliam e controlam o risco dos sistemas de IA antes de colocá-los em produção?"

Processo documentado, com critérios de risco e evidência de aprovação. Não é suficiente dizer que o time de TI analisa — precisa mostrar o processo.

"O que vocês fazem quando um sistema de IA produz um resultado incorreto ou prejudicial?"

Procedimento de resposta a incidente específico para IA. Quem aciona, quem decide suspender, como se documenta, como se comunica ao cliente afetado.

Essas perguntas não são teóricas. Estão aparecendo em auditorias de fornecedores nos EUA e Europa. Chegam ao Brasil por cadeia de fornecimento.

Prazos: onde estamos e para onde vai

A ISO 42001 foi publicada em dezembro de 2023.

O mercado de certificação está em estruturação. Organismos certificadores como BSI, Bureau Veritas e DNV já oferecem auditorias. As primeiras certificações no Brasil foram emitidas em 2024.

O EU AI Act tem prazos escalonados: as proibições absolutas entraram em vigor em fevereiro de 2025. Os requisitos para sistemas de alto risco chegam progressivamente até 2027. Fornecedores de IA geral têm obrigações a partir de agosto de 2025.

No Brasil, o PL de regulação de IA ainda tramita. Mas o impacto do EU AI Act chega antes da lei brasileira — via contratos com empresas europeias e via exigências de grupos multinacionais com operação local.

Empresas que exportam tecnologia, prestam serviços para empresas europeias ou têm clientes multinacionais já deveriam estar se movendo.

Por onde começar antes que vire obrigação

A certificação formal é o destino. Não é o primeiro passo.

O primeiro passo é saber onde a empresa está. Gap assessment contra os requisitos da ISO 42001: o que existe, o que falta, o que precisa ser construído do zero.

Tipicamente, o gap mais crítico é a ausência de inventário de sistemas de IA. Sem inventário, todos os outros controles ficam sem base.

O segundo passo é estrutura mínima: inventário, AI Owners designados, política com processo — não só documento.

O terceiro é o ciclo de avaliação de risco: cada sistema catalogado passa por avaliação, resultado documentado, revisão periódica.

A certificação vem depois — quando os processos estão funcionando e existe evidência acumulada para apresentar ao auditor.

Começar agora tem custo de projeto. Começar quando virar exigência tem custo de projeto mais custo de urgência mais custo de oportunidade perdida.

A ISO 27001 ensinou isso. Quem não aprendeu com a 27001 vai repetir o ciclo.

Saiba o score de risco de IA da sua empresa antes que alguém pergunte formalmente: alc.ia.br/score-risco.

Se o score mostrar gaps críticos, o diagnóstico define o roteiro para fechar: alc.ia.br/diagnostico.