O CIO está preso entre dois grupos que querem coisas opostas.

De um lado: o board e o jurídico querendo controle, documentação, processo de aprovação antes de qualquer uso de IA.

Do outro: as áreas de negócio que já estão usando ChatGPT, Copilot e Notion AI para trabalhar. Com ou sem aprovação.

Quem tenta resolver isso com um processo único para tudo quebra nos dois lados. Trava o que deveria andar rápido. E não controla o que realmente oferece risco.

O paradoxo real do CIO em 2026

A pergunta que o CIO recebe hoje não é mais "a empresa deve usar IA?".

A empresa já usa. A pergunta real é: quem sabe o que está em produção?

Em 2025, uma pesquisa da MIT Sloan com 400 empresas mostrou que 67% dos gestores de TI afirmaram não ter visibilidade completa sobre quais ferramentas de IA as áreas de negócio estavam usando. O dado não surpreende. Surpreende que alguém ainda ache que vai resolver com política de proibição.

O CIO que proíbe sem alternativa não elimina o risco. Empurra o uso para fora do perímetro. O Shadow AI não é hipótese — é o estado atual da maioria das empresas.

Governar não é proibir. É criar trilha viável para que o uso legítimo aconteça dentro do perímetro.

Por que processo único falha (trata copilot igual a modelo de crédito)

Imagine que a empresa decide criar um comitê de aprovação de IA.

Toda iniciativa passa pelo comitê. Documentação, avaliação de risco, aprovação formal.

A equipe jurídica quer usar o Copilot do Word para redigir contratos mais rápido. Precisa de aprovação do comitê.

A equipe de crédito quer implantar um modelo de machine learning que vai decidir automaticamente quais clientes recebem limite acima de 50 mil reais. Precisa de aprovação do comitê.

Os dois passam pelo mesmo processo. O mesmo formulário. O mesmo prazo.

O resultado: o jurídico espera 45 dias para usar uma ferramenta que já está no contrato do Microsoft 365. A área de crédito passa em 3 semanas porque o comitê estava sobrecarregado e aprovou sem revisar o modelo de viés.

Inversão total de prioridade.

Copilot de texto não é o mesmo risco que modelo de decisão de crédito. Tratar igual é o erro de partida.

Pronto para estruturar a governança de IA?

Diagnóstico completo: inventário, matriz de risco, plano 30/60/90 dias.

Agendar diagnóstico

Classificar antes de controlar: a saída prática

A solução começa com taxonomia, não com processo.

Antes de criar qualquer comitê ou formulário, a empresa precisa responder uma pergunta por sistema de IA: qual o impacto potencial de uma decisão errada ou tendenciosa desse sistema?

Impacto em pessoa física — emprego, crédito, saúde, liberdade: alto risco.

Impacto em processo interno sem consequência externa direta: baixo risco.

Todo o resto: risco médio, avaliação caso a caso.

Essa classificação não é opinião. Está alinhada com o EU AI Act e com o framework NIST AI RMF. Ambos partem da mesma lógica: risco determina processo, não o contrário.

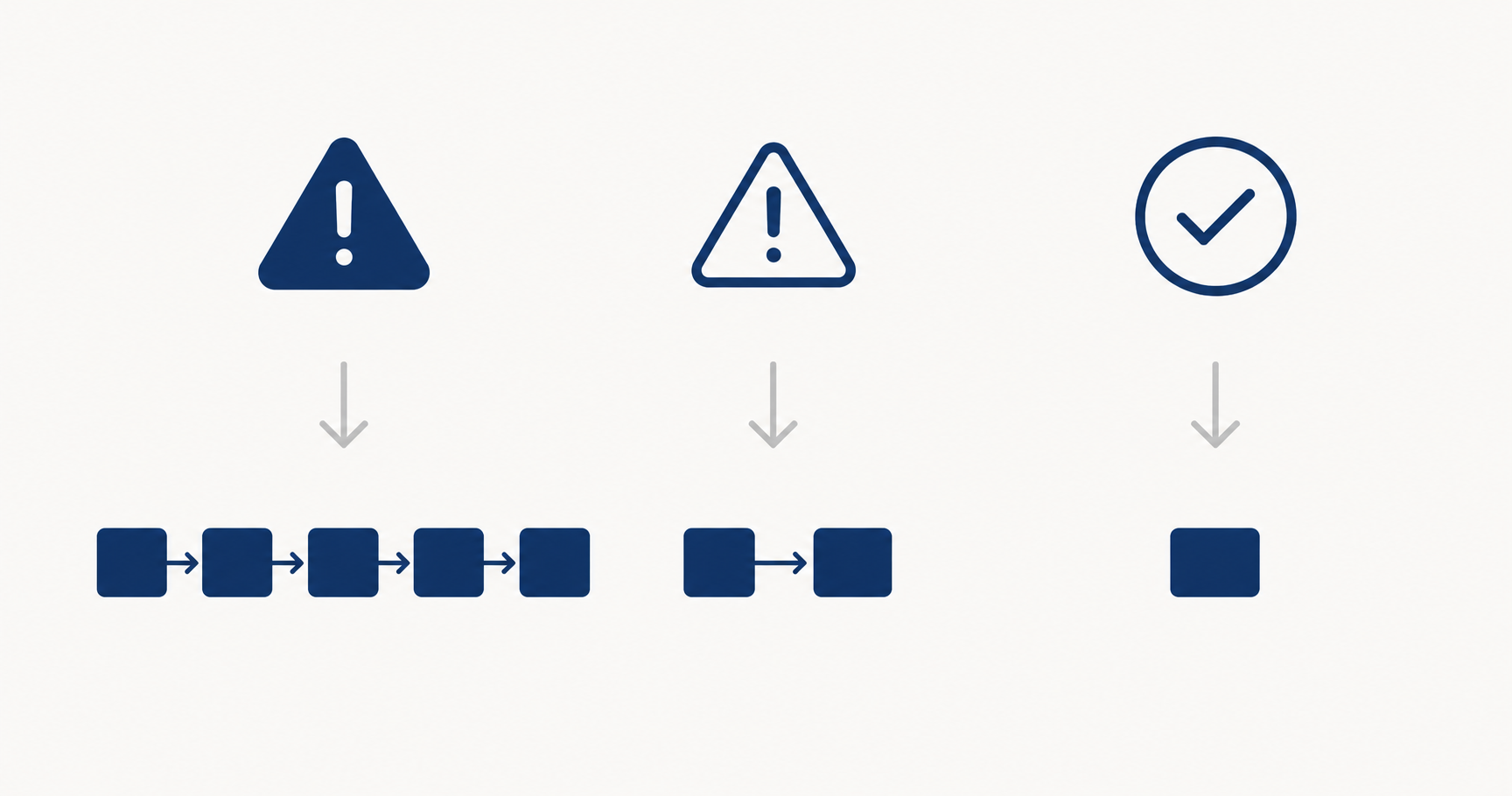

Com a classificação feita, o processo fica simples. Cada nível tem uma trilha diferente.

Processo por nível de risco — alto, médio, baixo

Risco baixo — fluxo rápido

Ferramentas de produtividade sem acesso a dados sensíveis. Copilot de texto, assistentes de escrita, sumarização de documentos públicos.

O processo: cadastro no inventário, aceite de política de uso aceitável, liberação automática.

Tempo: 24 horas. Sem comitê.

Risco médio — fluxo padrão

Sistemas com acesso a dados de clientes, integração com sistemas internos ou capacidade de recomendar ações que afetam processos de negócio.

O processo: cadastro no inventário, avaliação técnica de segurança, revisão de privacidade pelo DPO, aprovação do gestor da área. Sem necessidade de comitê formal.

Tempo: 5 a 10 dias úteis.

Risco alto — fluxo completo

Modelos que tomam ou influenciam decisões que afetam pessoas: crédito, contratação, precificação diferenciada, saúde, segurança.

O processo: análise de impacto completa (AI Impact Assessment), avaliação de viés, documentação de base de treinamento, aprovação do comitê com jurídico e compliance, plano de monitoramento contínuo.

Tempo: 30 a 60 dias. Com revisão periódica após implantação.

Esse modelo resolve o paradoxo. O que é simples anda rápido. O que é complexo recebe atenção proporcional.

Como apresentar ao board em linguagem de risco, não de tecnologia

O board não quer saber da arquitetura do processo.

Quer saber de três coisas: qual a exposição atual, qual o custo de estruturar, e qual o prazo.

A apresentação para o board segue essa estrutura:

Exposição atual: quantos sistemas de IA estão em produção sem processo formal. Qual o subconjunto que envolve decisão sobre pessoas. Qual o subconjunto sem documentação de base de dados.

Custo de estruturar: quanto custa implantar o modelo de três níveis. Isso inclui tempo interno, eventual apoio externo, e custo de certificação se a empresa decidir seguir pela ISO 42001.

Prazo: com metodologia de três níveis, as empresas que passaram por esse processo levaram entre 90 e 120 dias para ter o inventário completo e os processos rodando. Não é uma transformação de 3 anos. É um projeto de um trimestre.

O que o CIO não deve apresentar: roadmap de tecnologia, arquitetura de plataforma, plano de adoção de IA. Isso é conversa de equipe técnica.

Para o board, o argumento é risco financeiro evitado e capacidade de responder a clientes enterprise e reguladores com documentação real.

Governança de IA não trava inovação quando está calibrada por risco.

Trava quando trata tudo igual — e o CIO ainda não separou o que importa do que não importa.

Mapeie os sistemas de IA da sua empresa: alc.ia.br/diagnostico